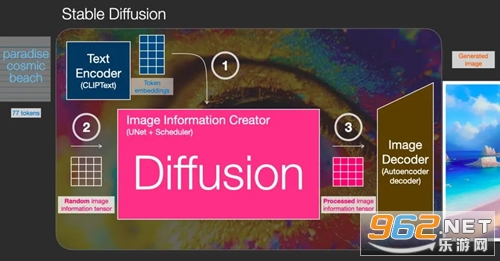

[���ξW���x]��stable diffusion����2022��l������ȌW�����ֵ��D������ģ�͡�����Ҫ���ڸ������ֵ������a��Ԕ���D���܉��ڎ���犃Ȅ����������@�@��ˇ�g��Ʒ�����^�������M�ģ�ÿ���Ñ���sֻ������200���DƬ���~������֮����Ҫ��ֵ����ʹ�á�

��stable diffusion����2022��l������ȌW�����ֵ��D������ģ�͡�����Ҫ���ڸ������ֵ������a��Ԕ���D���܉��ڎ���犃Ȅ����������@�@��ˇ�g��Ʒ�����^�������M�ģ�ÿ���Ñ���sֻ������200���DƬ���~������֮����Ҫ��ֵ����ʹ�á�

stable diffusion�֙C�����d���c�����d

stable diffusion�پW��ַ���c���M��

stable diffusion���bʹ�ý̳�

һ��ǰ�Խ�B

Ŀǰ�����ϱ��^�������������ڹ����е�AI�L��ܛ���䌍�̓ɿһ����Midjourney�����ĺ��QMJ������һ����stable-diffusion�����ĺ��QSD����

MJĿǰ�����M����Ҫʹ�ñ�횳�ֵ��һ����10��Ԫ����ͨ��������AI�L�����������㡣��SD�_Դ���M�����������y�ȸߣ��W���ɱ��ξ�һ�����b�����y��һ��Ƭ�ˡ����ҷdz�����X���ã��@�����ȴ棩��

����ܽ�Q���b���}���W�����}����X���ܣ�����������l�F��SD�Ŀ��������̫���ˣ���ֱ�ӵă��c�����û��X߀���ܾW�j����😆��

�����_Դ���ԣ�SD �кܶ����M���|��������AӖ��ģ�ͣ�fine-tune���Ͳ�������������ȡ���w݆�������w�˄ݹǼܡ����������Ϣ���M���Z�x�ָ�IJ�� Controlnet��ʹ���������҂����L���^���о��ʿ�������Ą����˄ݡ��քݺͮ��昋�D�ȼ���

��� Mov2Mov ���Ԍ�����ҕ�l�M���L���D�Q��SD ߀���� Inpainting �� Outpainting ���ܣ����Ԍ��D���M�����ֲܾ��ĺ����ӣ��@Щ����Ŀǰ Midjourney �o�������ġ�

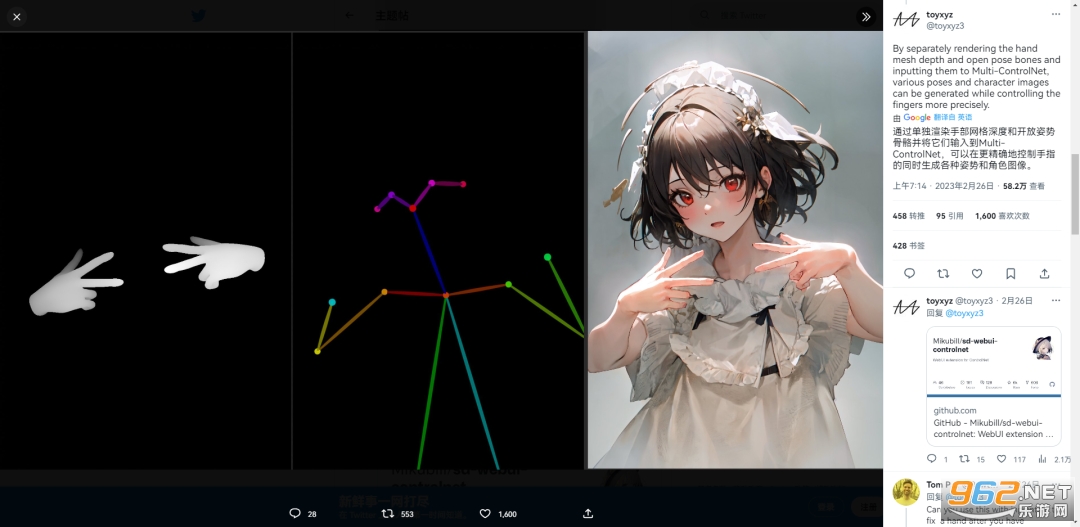

��������@Toyxyz3 ͨ�^�քe��Ⱦ�ֲ��W����Ⱥ��_���˄ݹ����ķ�ʽ���� SD �Ȍ��F��������ָ���˄ݵľ��ʿ���

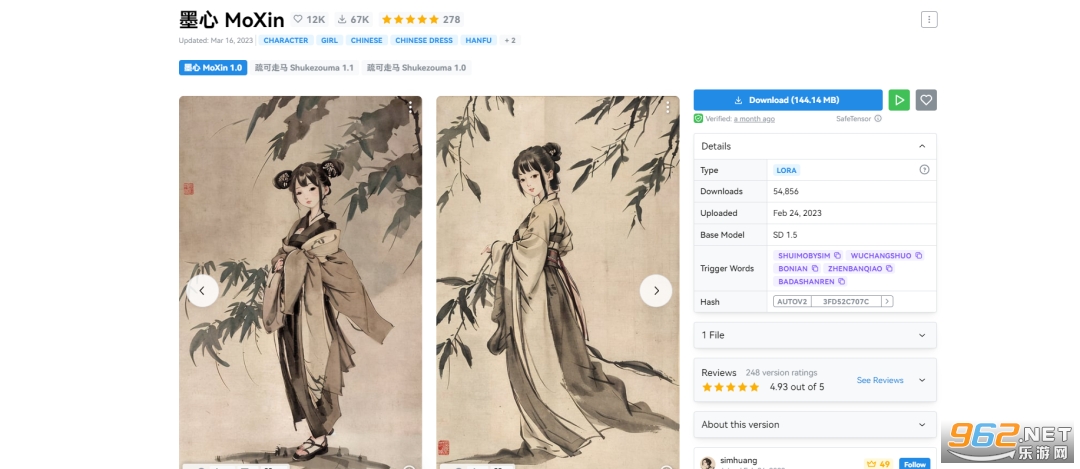

߀������SD LORA ���� Dreambooth ���Լ�ϲ�g������������߮��LӖ������ģ�ͣ������Լ��Č��� AI �L�����ߣ�Ҳ�Ю������OӋ�����Լ���ԭ����ƷӖ��ģ�ͣ�֮�����`���˾�֮������������������ SD ���Լ����ٳ����N����݈D��

SD�_Դ��ַ

https://github.com/Stability-AI/stablediffusion

������XҪ��

��X��������ĵ��P�I�c�����@�������ȴ桢��Ӳ�P����CPU����������Ҫ���ǿ��@����

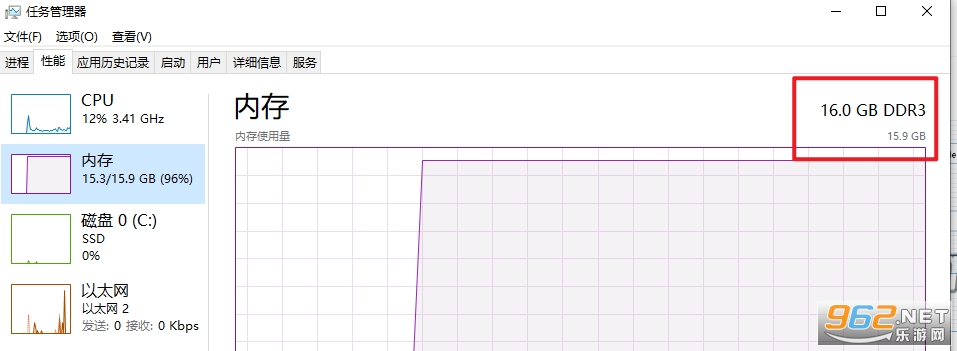

�@��N����Ӣ���_Nvida�@����A���ò��ˣ������10ϵ���@�����4G��6G�����ϲ���픣��ȴ����8G��16G�����ϲ���픣�Ӳ�P���ÿ��g����Ђ�500G���ϣ��̑B��ѣ��CеӲ�PҲ�]����}��CPU�䌍�]̫��Ҫ���к��@���ģ�CPUһ�㲻���ܲ

��ο��Լ�����X�@����

���_�΄չ����������� - GPU �����ɿ����@�档ֻҪ����4G��������һ�档��߅�Ђ������ڣ����һ����Ӱ汾�����ڶ��У�ֻҪ�e̫�h�ž��У����µ����¸��á�

��ο��Լ�����X�ȴ棿

߀�����΄չ��������c��ȴ棬���ϽǼ��ɿ����ȴ�������

�������b�̳�

������������ǂ��_Դ��ַ���b���]���|�^���a���ˣ��û�һ����r�g���ܸ㶨������һ�����㶼�㲻����

��Ҫ��С���e���ְ��ֽ̳ɣ��Ҹ��X�÷ֺÎ�ƪ���£�Python���b��Git���b���@���������Լ�CUDA��webui.........😂😂ֱ�ӄ��ˡ�

�����д�������һ�I���ӳ����ȵ����~�������A1111���O��Ľ����˰��b�T������ƪ���A�̳̣��҂���ʹ��һ�I���Ӱ����֣������wSD�Ę�Ȥ��һ�I���Ӱ�ֻ�Ƿ��b�˿�ҕ����һ�I���棬����Ӱ푳��DЧ������ֻ��ʡȥ�˱��ز�����T����

�҂�ʹ�����~���� (bilibili:���~aaaki) ��һ�I���Ӱ���

https://pan.baidu.com/s/1qWggi0qMMTdMpqCNCRcjoQ?pwd=a241

�D���ֹʧЧ��

https://pan.baidu.com/s/1_oY7lqRqWn330yEjIIhTxg?pwd=6666

�ٷ�Փ��ӑՓ��ַ��

https://support.qq.com/product/488228

01

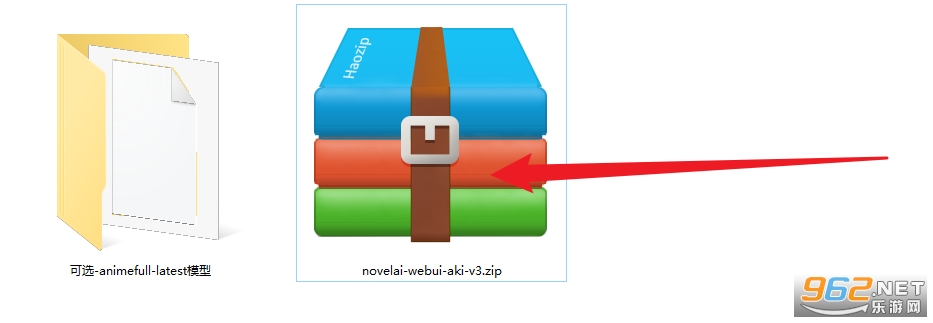

���d��≺

02

�c�������c��һ�I����

03

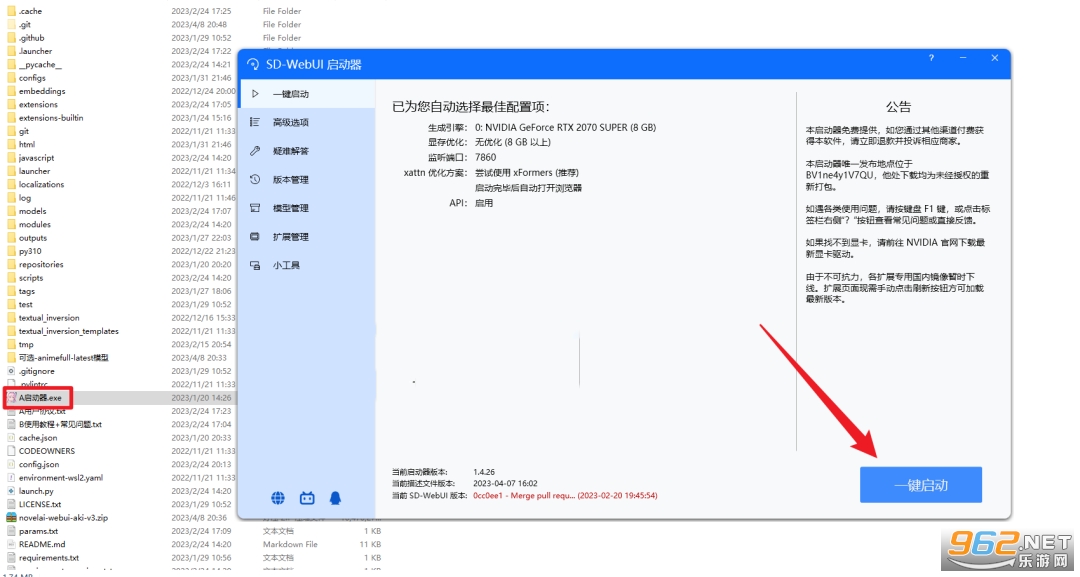

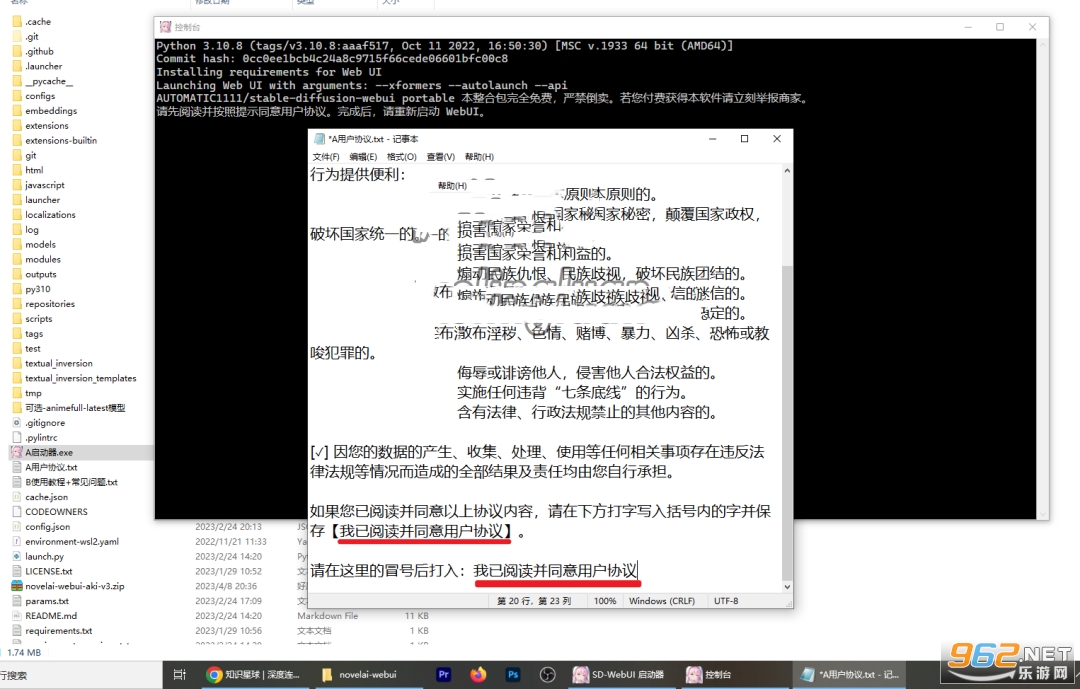

�״Ά��ӣ�����txt�ı�������Ҫ����ճ�N ������x��ͬ���Ñ�f�h ������txt

����һ�I����

04

���ӳɹ��������@ô����😂😂

05

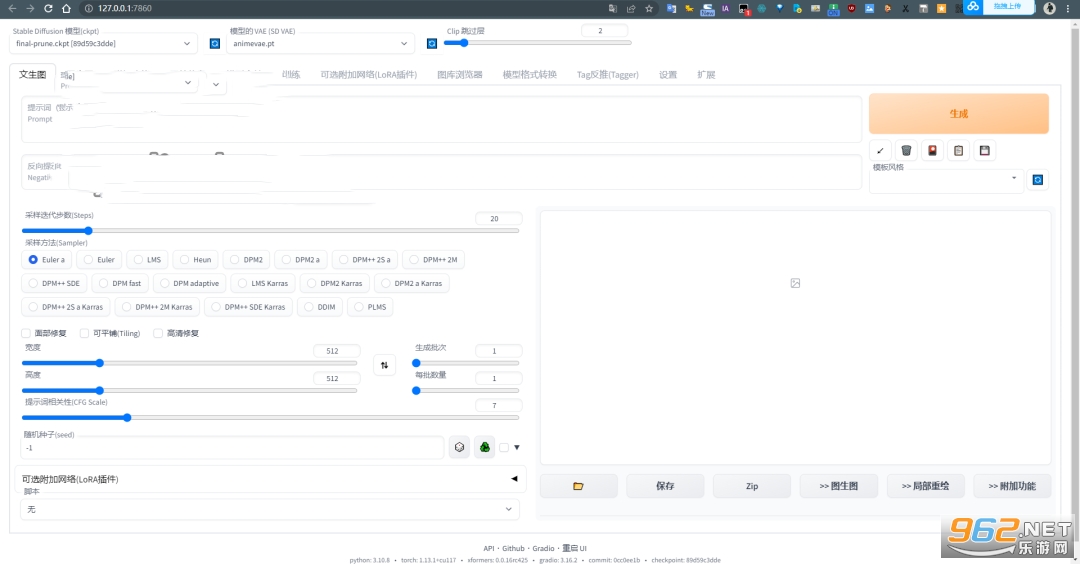

Сԇţ��һ�£���ҿ���ݔ���@һ��ָ�Ȼ���c�����ɣ����½Ǽ��ɳ��D������Ч����

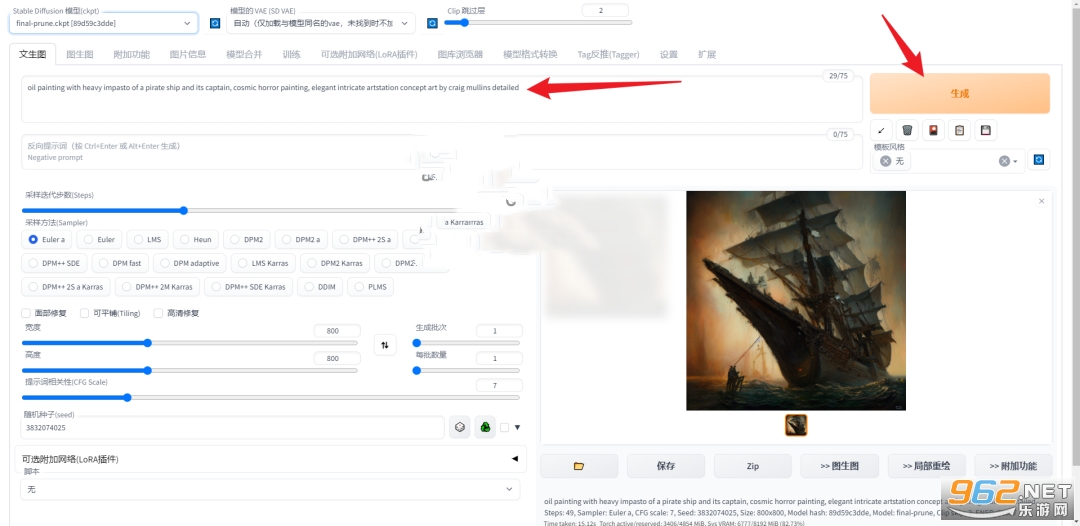

oil painting with heavy impasto of a pirate ship and its captain, cosmic horror painting, elegant intricate artstation concept art by craig mullins detailed

�ġ����bģ��

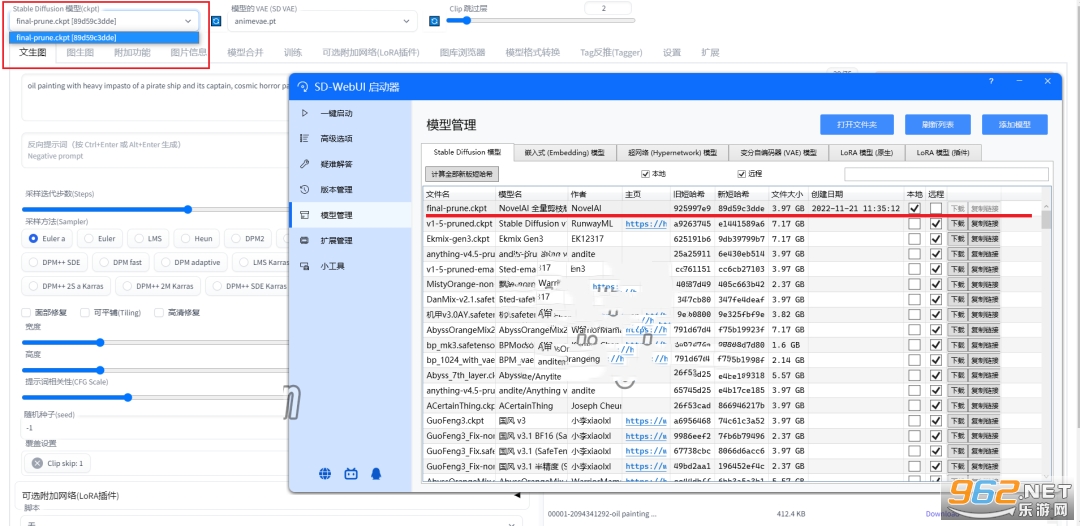

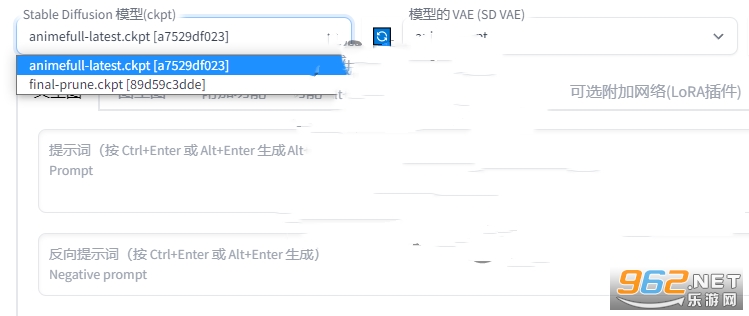

Ĭ�Jֻ��һ��ģ�ͣ��چ�����ģ���������Կ��������ش�������ʹ�ã�������ģ����Ҫ���d����ʹ�á��҂���webuiҲ���Կ�����ֻ���@һ��ģ�Ϳ��x��

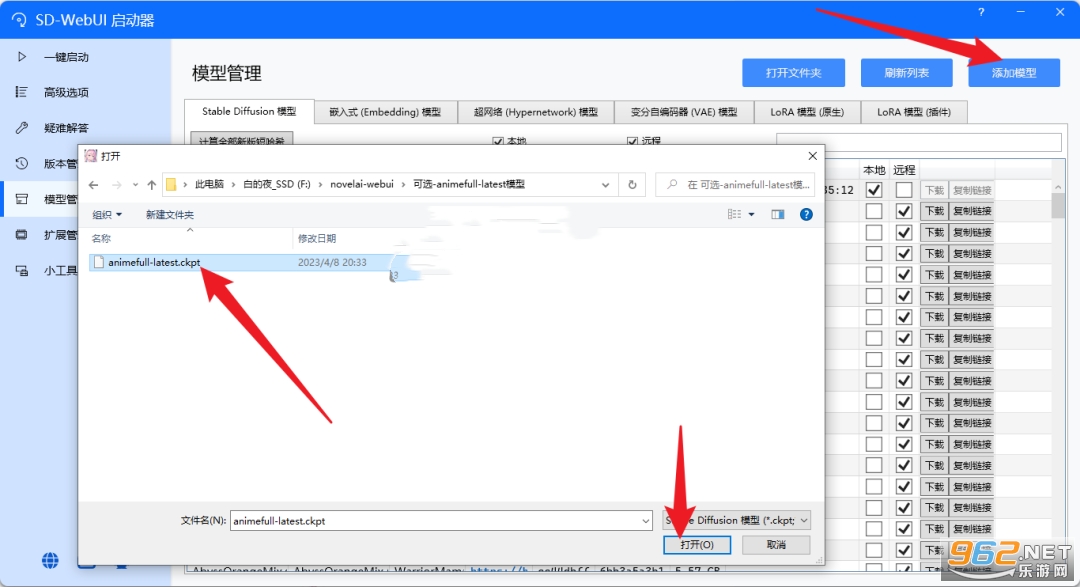

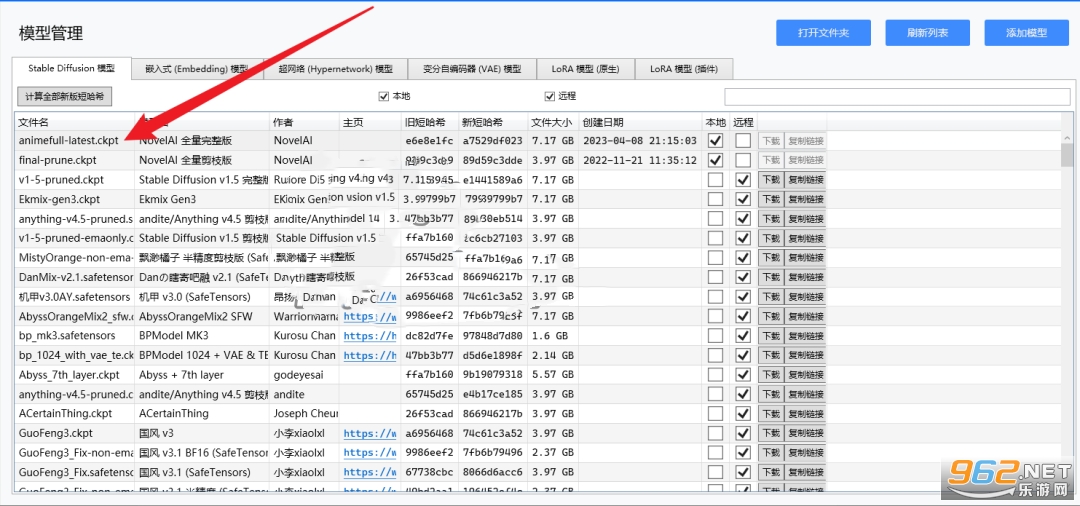

��Ό����أ������d���b���ĕr���������һ�� ���x-animefull-latestģ�ͣ����@����������ʾ����ģ��

01

�c���Ͻ�����ģ�ͣ��ڏ������ļ����������x��ģ�ͣ���Y�� .ckpt ,�c�����_

02

�ɹ�����

03

�P�]�����_�����ӣ�webui�Ϳ��Կ��������ӵ�ģ����

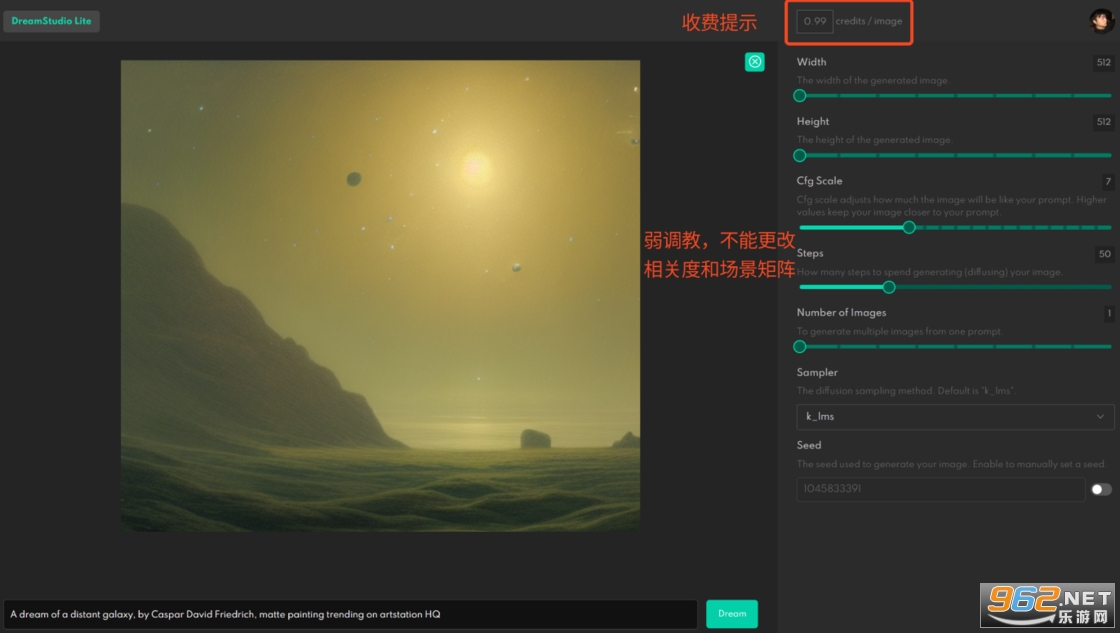

stable diffusion2.2���ز�������Ҫ�� stable diffusion a�����b��

Stable Diffusion �����ı����ɈD��� AI ���ߣ�Ҳ��Ψһһ���ܲ����ڼ�����X�ϵ� AI �L�D���ߣ������� RTX 2060 �@���� 6GB �@�棨�����ϣ��@�����\�У����ڎ���犃����ɈD�o���A̎���ͺ�̎������Ȼ�����ֻ�����w� Stable Diffusion��Ҳ����ʹ���ھ����� Hugging Face �� DreamStudio���c���ز�����ȣ�Hugging Face ����ꠣ�����һ���D�s 5 ��犣�DreamStudio �����M���� 200 ���DƬ��֮����Ҫ�U�M������Ҫ���ǣ��@��ھ����ߌ��DƬ���{�̹���ƫ�����o���������ɈDƬ��ֻ�������yԇ�w

����������ʹ�ã���������һ�ӣ�ʹ�� Docker Desktop �� Stable Diffusion WebUI Docker ������ Windows ϵ�y���Ķ�������X�@�����M���F AI �����L�������ٱ��ھ����������ơ�Mac ͬ���m����ԓ����������ʡ���·��ĭh�����ò��E��

stable diffusion ��ʾ�~�б�

�@��һ��ͨ�õ�ָ�ϣ������ǻ���ͨ�õģ�������������r��Ո�x�������¹��˽ⲻͬ���������ԡ�

��ʾ�~����ʾ�������ж�������������ݔ���|���ж��~�R�ĕr���䌍�������Ɣ����ķ����������� ��Ҫ�� AI ��һ���ܺõĈDƬ��

���~�˺�#

�����ژ˺����~���ػ�Ӗ����ģ�ͣ����hʹ�ö�̖���_�Ć��~������ʾ�~��

��ͨ��Ҋ�Ć��~�������ǿ����ڔ�������Դվ�c�ҵ��������˺������� Danbooru)�����~���L��Ҫ�͈D������w�L����䣬��t�����F���s���L������c��

������Fƴ���e�`��NLP ģ�Ϳ��܌�ƴ���e�`�Ć��~��֞���ĸ̎����

��Ȼ�Z��#

��������Ȼ�Z�����ػ�Ӗ����ģ�ͣ����hʹ���������w�ľ���������ʾ�~��

ȡ�Q��Ӗ���rʹ�õĔ�����������ʹ��Ӣ�ģ����ģ������̖��һЩ���ġ��������r��Ӣ���^����Ч��

���� with ֮��B���~����s���Z�����������r�� NLP ģ��ֻ���M����ε�̎����

����ʹ������������ �� �� �����͵��Z umlauts���� ä �� ö�����������ܟo����ӳ�䵽���_���Z�x�С�

�����h�S�����ìF��ģ�壬�����ǟo�����^��������ģ�塣

Emoji#

Emoji (💰,💶,💷,💴,💵,🎊,🪅🪄,🎀,👩🚀) �����̖Ҳ�ǿ���ʹ�ò��� �dz��ʴ_ �ġ�

Emoji ���ֻ��һ���ַ����������Z�x�ʴ_���ϱ��F���á�

Emoji �ژ��D����Ӱ푣����� 💐☺️💐��

�����̖����

�����#

����ʹ�� Danbooru ������ģ�́��f������ʹ���������һ���̶��Ͽ��Ƴ��D�ı��顣

���磺

:-) Ц :-( ���� ;-) ʹ��ɫ :-D �_�� :-P �����^ :-C �ܱ��� :-O �@Ӡ ����� :-/ ����

�H֧����������֣�Ԕ������ՈҊ Danbooru ����ֲ��� �� �S���ٿ�

�ո�#

��̖ǰ��������ո�Ӱ푌��HЧ����

�_�^�ͽYβ���~��ո����ֱ�ӁG�����~�c�~֮�g���~��ո�Ҳ�����G����

���c��̖#

�ö�̖����̖�������ǿ��ַ���\0�����ָ��P�I�~��������߈D���|����Ŀǰ߀������ķN��͵Ę��c��̖���ķN�M��Ч����á������Ɇ��r��ֻҪ��һ�Nʹ��ʾ�����ױ���x�ķ�ʽ������

���ڲ���ģ�ͣ����h��������_���D�Q��ո�

ˇ�g�L���~#

����ͨ�^ָ���L���P�I�~�턓��������Ч��ָ�����L�ĈDƬ��

��ʾ�~�L��# ��ʾ�~����������ǃ��ȼ���������ʾ�~�ę���ֵ��ǰ����f�p���������e�������ʾ�~�ѽ����DƬ�Č��H����Ӱ�����

���ѯB��ʾ�~��һ�������T�����������_���кܶ�����Ҫ���������m��������ɲ������Ա��������^���и��õ�������ʾ�~��

SD-WebUI ͻ����� 75 ���~�M���Ƶķ�ʽ�nj�ÿ 20 + 55 ���~�֞�һ�M���x� Increase coherency by padding from the last comma within n tokens when using more than 75 tokens ����ԇ�Dͨ�^������� N ����ӛ���Ƿ������һ����̖�������@�N��r������У��t�����н��^ԓ��̖�ă���һ���Ƅӵ���һ�������С�ԓ���Կ��m��������ʾ�~�^���o��̎���Ć��}���������Ɖ���ʾ�~֮�g�ę����Pϵ��

���� WebUI ������r�M��������̎���⣬���� GPT-3 ģ�����ƣ���ʾ�~̎�����g�����ǟo�ģ�������� 75-80 ֮�g��75 �ַ���ă��ݕ����ؔࡣ

�خ���#

���}�w�F���Z�xƫ���ϡ������W�j��Ӗ�����f���������|������Ҫ��ݔ���ݔ��֮�g��ϵԽ�����W�j��Խ���W���@�Nϵ��

�Q��Ԓ�f�����һ���P�I�~�зdz����w�ĺ��x����ô�W�����c�D��֮�g��ϵҪ��һ���P�I�~�зdz��V���ĺ��x���öࡣ

�@��һ������ʹ���� ��Zettai Ryouiki�� �@�Ӻ���ʹ�õ��P�I�~Ҳ�ܮa���dz��õĽY���������ֻ�ڷdz����w����r��ʹ�á���һ���棬�������� ��ʹ��һ�����^��Ҋ���~��Ҳ�����a���ܺõĽY�����@������������������S�ͬ����r����ʹ�Ǜ]��������˼�Ą�����������������ĈDƬ�ă��ݣ��x����w���P�I�~������Ҫ�����⣺��Ĵ��oԽ������Խ�á�������ܵ�Ԓ���������½�ጿ��g�Ĵ��o������Ҫ �����⣬ �����ڈD��Ė|���������� ���� �� ��С�� �@�ӵĸ���Ҳ���І��}�ģ���������c���w�x���C�����h�ǟo���^�ֵġ�������r�£�ʹ���кܴ�������ֳ��F������Ҫ�ĈD����}�ϵĴ��o��

�Z�xʧ��#

ÿһ����ʾ�~����Ⱦ��һ�ӣ������� ���H���ԡ� ��ͬ���������Ҋ����ʾ�~������ loli (��������ʾ�~���з���)��Ӱ푾ʹ���������ʾ�~�� ���磬����������Ʉ����DƬ��ʹ���� �ǿ� startrail �˺���������������F�Ą����ǿգ����и��������挍��Ƭ���ǿ�Ԫ�ء�

����ʾ�~#

SD-WebUI �W퓑��Õ������ɕr �������ɷ���ʾ�~�ἰ�ă��ݡ�

����ʾ��һ�Nʹ�� Stable-Diffusion �ķ�ʽ�����S�Ñ�ָ�������뿴���ă��ݣ�������ģ�ͱ������~���Ҫ��

ͨ�^ָ�� unconditional_conditioning �������������вɘ������鿴ȥ��������ʾ�ĈD�DZ�����ȥ�����������ؓ����ʾ�ĈD���w����F�֮�g�IJ�����Lԇ����K�Y���h�x����ʾ�~��

����ʹ��������ʾ�~��������ˮӡ�����փ��ݣ�

lowres, bad anatomy, bad hands, text, error, missing fingers,

extra digit, fewer digits, cropped, worst quality, low quality,

normal quality, jpeg artifacts, signature, watermark, username, blurry ߀���@�����ӣ�

ugly, fat, obese, chubby, (((deformed))), [blurry], bad anatomy,

disfigured, poorly drawn face, mutation, mutated, (extra_limb),

(ugly), (poorly drawn hands fingers), messy drawing, morbid,

mutilated, tranny, trans, trannsexual, [out of frame], (bad proportions),

(poorly drawn body), (poorly drawn legs), worst quality, low quality,

normal quality, text, censored, gown, latex, pencil

ϲ�g

ϲ�g  �

� �o��

�o�� ���^

���^ ��

�� �y�^

�y�^ Stable Diffusion AI����(AI painter)v1.14 ���°�

�����ù��� / 23-04-14

Stable Diffusion AI����(AI painter)v1.14 ���°�

�����ù��� / 23-04-14

Stable Diffusion Ai app���b v1.0

�����ù��� / 23-03-31

Stable Diffusion Ai app���b v1.0

�����ù��� / 23-03-31

stable diffusion2.0�֙C��app���°� v1.14

�����ù��� / 23-04-16

stable diffusion2.0�֙C��app���°� v1.14

�����ù��� / 23-04-16

Stable Diffusion2.0(AI painter)v1.14 �֙C��

�����ù��� / 23-03-08

Stable Diffusion2.0(AI painter)v1.14 �֙C��

�����ù��� / 23-03-08

�����Ӛ�(Sigma Battle Royale)v1.1.0

��������� / 23-07-28

�����Ӛ�(Sigma Battle Royale)v1.1.0

��������� / 23-07-28

���ѵ��������°�(Strong Archer Run)v1.0.0 ����

��������� / 23-04-14

���ѵ��������°�(Strong Archer Run)v1.0.0 ����

��������� / 23-04-14

���T�uՓ

�����uՓ